人工智能基礎軟件開發:從零理解神經網絡

引言:為什么神經網絡是人工智能的核心?

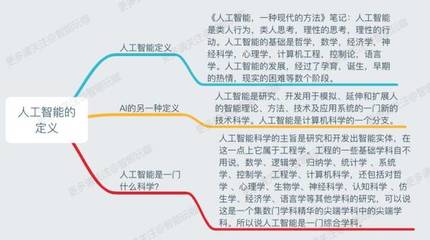

人工智能(AI)正以前所未有的速度改變著我們的生活,從智能手機的人臉識別到自動駕駛汽車,其背后大多離不開一種名為“神經網絡”的技術。對初學者而言,神經網絡聽起來可能高深莫測,但它其實是一個模仿人類大腦工作方式的數學模型。本篇文章將用最通俗易懂的語言,帶你邁出理解神經網絡的第一步,并了解如何通過基礎軟件開發將其實現。

第一部分:神經網絡是什么?一個生動的比喻

想象一下,你第一次學習辨認一只貓。

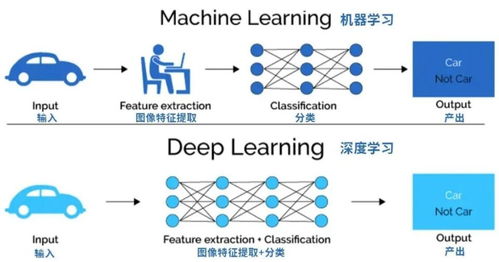

- 你看到一張圖片(輸入)。

- 你的大腦會分析特征:它有尖耳朵、胡須、橢圓形的眼睛和毛茸茸的尾巴(特征提取)。

- 你將這個組合與你記憶中“貓”的概念進行比對(模式匹配)。

- 最后得出結論:“這是一只貓!”(輸出)。

神經網絡的工作流程與此驚人相似:

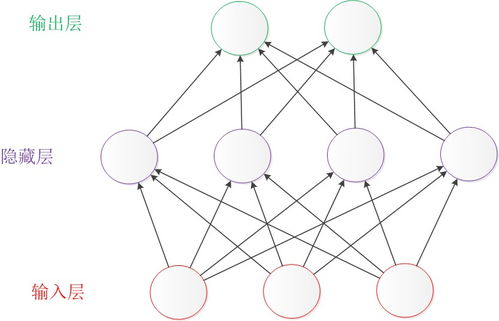

- 輸入層: 接收原始數據(如圖像的每個像素點)。

- 隱藏層: 由眾多“神經元”(或稱節點)組成,每個神經元負責檢測某種簡單特征(如邊緣、顏色塊)。層數越多,能識別的特征就越復雜。

- 輸出層: 給出最終判斷或結果(如“貓:95%概率”)。

數據在這些層中向前流動,就像信息在大腦的神經元網絡中傳遞一樣,因此得名“神經網絡”。

第二部分:核心基石——“神經元”如何工作?

一個最簡單的人工神經元(或稱感知器)做三件事:

- 接收輸入:每個輸入(比如像素的亮度值)都乘以一個“權重”。權重代表了該輸入的重要程度。耳朵特征的權重可能比背景特征的權重大得多。

- 加權求和:將所有加權后的輸入加起來,再加上一個“偏置”(一個調整項,幫助模型更好地擬合數據)。

- 激活判斷:將求和結果送入一個“激活函數”。你可以把它想象成一個開關或過濾器,它決定這個神經元是否被“激活”(即輸出一個較強的信號)。常用的激活函數如Sigmoid或ReLU,能將結果映射到一個固定范圍內。

簡單公式表示: 輸出 = 激活函數( (輸入1 × 權重1) + (輸入2 × 權重2) + ... + 偏置 )

成千上萬個這樣的簡單神經元連接在一起,就能完成極其復雜的識別任務。

第三部分:基礎軟件開發入門——用Python構建你的第一個神經網絡

理解了概念,我們來看看如何用代碼實現它。Python因其豐富的AI庫(如TensorFlow, PyTorch)而成為首選語言。

環境準備:

- 安裝Python(推薦3.8以上版本)。

- 安裝核心庫:在命令行中運行 pip install numpy matplotlib tensorflow。

一個極簡的代碼框架:

`python

import numpy as np

import tensorflow as tf

from tensorflow import keras

1. 數據準備:用經典的MNIST手寫數字數據集為例

mnist = keras.datasets.mnist

(trainimages, trainlabels), (testimages, testlabels) = mnist.loaddata()

trainimages, testimages = trainimages / 255.0, test_images / 255.0 # 歸一化,將像素值壓縮到0-1之間

2. 構建神經網絡模型

model = keras.Sequential([

keras.layers.Flatten(input_shape=(28, 28)), # 輸入層:將28x28的圖片展平為784個像素點

keras.layers.Dense(128, activation='relu'), # 隱藏層:128個神經元,使用ReLU激活函數

keras.layers.Dense(10, activation='softmax') # 輸出層:10個神經元(對應0-9十個數字),使用Softmax函數輸出概率

])

3. 編譯模型:配置學習過程

model.compile(optimizer='adam', # 優化器:決定如何根據誤差調整權重

loss='sparsecategoricalcrossentropy', # 損失函數:衡量模型預測值與真實值的差距

metrics=['accuracy']) # 評估指標:這里關注準確率

4. 訓練模型:讓模型從數據中學習

model.fit(trainimages, trainlabels, epochs=5) # 訓練5輪

5. 評估模型

testloss, testacc = model.evaluate(testimages, testlabels, verbose=2)

print(f'\n測試準確率:{test_acc}')

6. 進行預測

predictions = model.predict(test_images)

print(f'第一張測試圖片的預測結果(概率分布):{predictions[0]}')

print(f'預測數字是:{np.argmax(predictions[0])}')`

代碼解讀:

- 我們構建了一個最簡單的三層(輸入層、一個隱藏層、輸出層)全連接網絡。

- model.fit 是核心訓練過程,模型會自動調整所有神經元的權重和偏置,以最小化預測誤差。這個過程稱為“反向傳播”和“梯度下降”,我們將在下篇文章詳細講解。

- 運行這段代碼,你將得到一個能夠識別手寫數字的AI程序!雖然簡單,但它包含了神經網絡軟件開發的所有核心步驟。

第四部分:關鍵概念梳理

- 前向傳播: 數據從輸入層流向輸出層,得到預測結果的過程(如上文代碼中的

predict步驟)。 - 損失函數: 衡量模型“錯得有多離譜”的尺子。訓練的目標就是最小化這個值。

- 優化器: 損失函數的“導航儀”,它根據損失值計算如何調整網絡中的權重(最常用的是Adam)。

- epoch(輪次): 將全部訓練數據完整學習一遍稱為一個epoch。

與下篇預告

至此,你已經對神經網絡有了最直觀的理解,并且成功運行了第一個神經網絡程序。你看到了它如何像大腦一樣分層處理信息,也看到了用高級框架(如TensorFlow)可以如何簡潔地實現它。

我們只是讓模型“運行”了起來,它內部最精妙的學習機制——“模型是如何通過數據自動調整權重(即學習)的?”——尚未揭曉。這正是神經網絡被稱為“學習”的關鍵。

在下篇文章中,我們將深入神經網絡的“學習引擎”,用最清晰的圖解和類比,揭秘 “反向傳播” 和 “梯度下降” 的奧秘,并探討更復雜的網絡結構(如卷積神經網絡CNN)。你將徹底明白,人工智能是如何從數據中自我成長的。

讓我們保持好奇,一起深入AI的核心。